图卷积神经网络 (GCN)

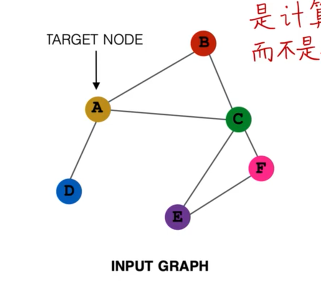

对于一个类似这样的图,记$A_{node_nun\times node_num}为邻接矩阵$, $A_{A,:}$ 表示了node A的连接方式

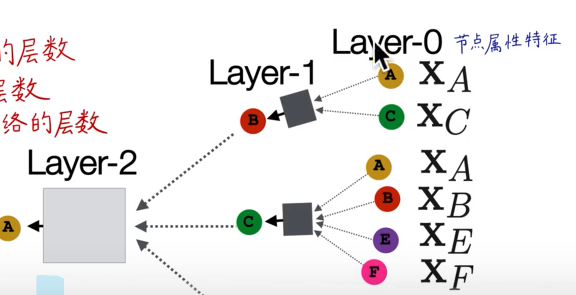

我们用一个图卷积神经对其进行表示学习,比如说对于A,我们设置一个3层的计算图深度,相当于它的视野域可以看到和A连接2层的node

这里的计算题不能过深,否则会导致各个节点的output趋同,一般2层就够了

计算图深度不等于神经网络深度,神经网络深度理论上可以无限深

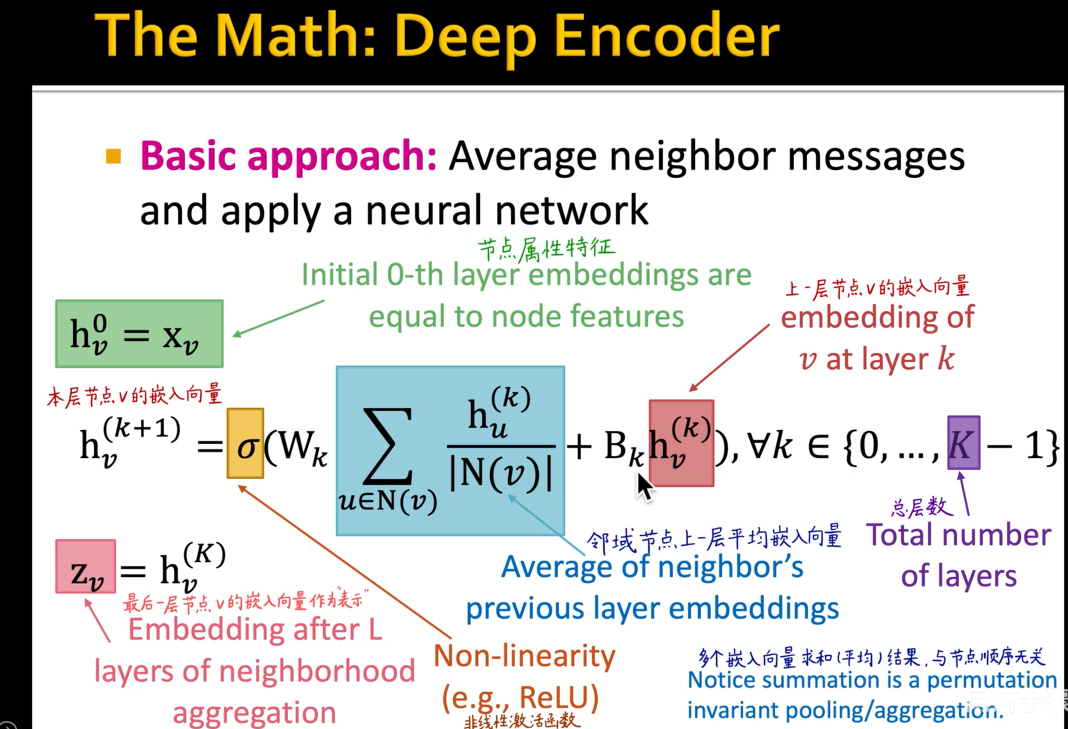

图卷积计算图公式

$$ H^{(l+1)}=\sigma(D^{-\frac{1}{2}}\widetilde{A}D^{-\frac{1}{2}}H^{(l)}W^{(l)})\ \ \ (\widetilde{A}=A+E_{node\_num\times node\_num}) $$params:

D:对角矩阵,表示为每个节点连接的个数,可以理解为一个节点如果连接的节点数过多,难免对这些节点影响是有限的

W:训练矩阵

l:第l层